数据治理与数据集成 构建高效数据处理服务的关键框架

在数字化转型的浪潮中,数据已成为企业最核心的资产之一。如何有效管理、整合并利用这些数据,是每个组织面临的共同挑战。数据治理、数据集成与数据处理服务,构成了现代数据管理体系的三大支柱,共同支撑着从数据到洞察、从洞察到决策的完整价值链条。

一、数据治理:奠定数据价值的基石

数据治理是一套涵盖政策、标准、流程和技术的综合体系,旨在确保组织内数据的可用性、一致性、完整性、安全性和合规性。其核心目标并非单纯的技术管控,而是建立一套权责清晰的管理框架,使数据能够作为可信赖的资产服务于业务目标。

关键组成部分包括:

1. 战略与组织:明确数据治理的目标,设立数据治理委员会、数据所有者、数据管家等角色,确保责任到人。

2. 政策与标准:制定数据质量、安全、隐私、主数据和元数据的管理标准与规范。

3. 数据质量管理:通过探查、清洗、监控和修复,持续提升数据的准确性、完整性和时效性。

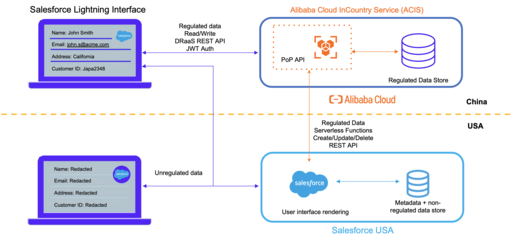

4. 安全与合规:确保数据访问受控,符合GDPR等法律法规要求,防范数据泄露与滥用风险。

有效的治理是后续所有数据活动的基础,它决定了数据的“可信度”。

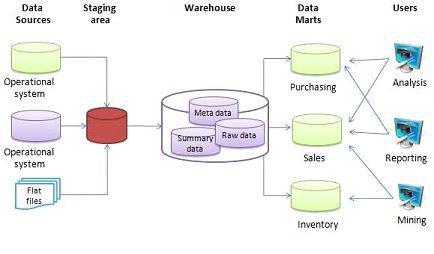

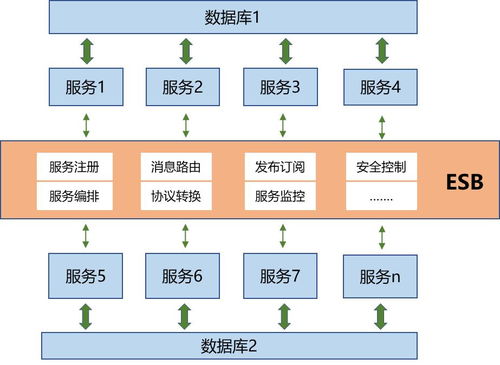

二、数据集成:打通信息孤岛的生命线

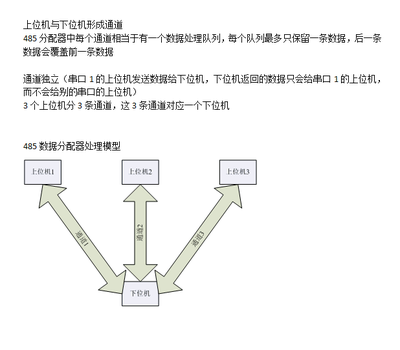

数据集成的核心任务,是将分散在不同系统、不同格式、不同结构中的数据进行合并、转换与整合,形成一个统一、一致的视图。随着数据源从传统数据库扩展到云应用、物联网设备、社交媒体等,现代数据集成面临着实时性、多样性、海量性的挑战。

主要模式与技术:

1. 批处理集成:定时(如每日)进行大批量数据迁移与同步,适用于对实时性要求不高的场景。

2. 实时/流式集成:持续捕获和处理数据流(如Kafka, Flink),实现秒级甚至毫秒级的延迟,用于监控、实时推荐等。

3. ETL与ELT:

- ETL(提取、转换、加载):数据在到达目标数据仓库前完成清洗和转换。

- ELT(提取、加载、转换):借助云数据仓库的强大计算能力,先将原始数据加载入仓,再在仓内进行转换,灵活性更高。

- 数据虚拟化:提供统一的逻辑数据层,在不移动物理数据的情况下实现实时查询与访问,是快速集成的一种轻量级方案。

数据集成是连接“原始数据”与“可用数据”的桥梁,是激活数据价值的关键一步。

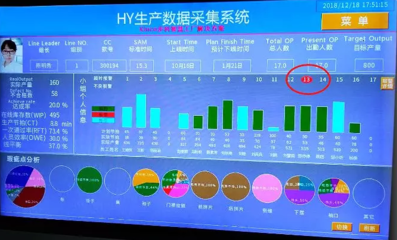

三、数据处理服务:驱动业务价值的引擎

在治理和集成的基础上,数据处理服务负责对准备好的数据实施计算、分析与挖掘,将数据转化为直接的业务洞察和行动力。这通常表现为一系列可复用、可编排的服务化能力。

服务层次与典型应用:

1. 基础处理服务:提供数据清洗、格式标准化、轻度聚合等通用功能,作为更高级服务的基础组件。

2. 分析计算服务:支持复杂的批处理分析(如Hive, Spark)、交互式查询(如Presto)和在线分析处理(OLAP),服务于报表、BI看板等。

3. 智能与挖掘服务:集成机器学习平台,提供模型训练、特征工程、预测评分等服务,赋能精准营销、风险控制、智能运维等场景。

4. 数据API服务:将处理后的数据结果或模型能力,以标准API的形式封装并开放给前端应用或其他系统调用,是数据价值输出的最终端口。

三者的协同关系:构建闭环数据能力

数据治理、数据集成与数据处理服务并非孤立的环节,而是紧密衔接、循环促进的有机整体:

- 以治促用:数据治理为集成和处理定义了“游戏规则”,确保流入下游的数据是高质量、合规的,从源头保障了分析结果的可靠性。

- 以集承治:数据集成过程是执行数据质量规则、落实安全策略的重要环节,是治理落地的技术抓手。

- 以用验治:数据处理服务在消费数据的过程中,能够反馈数据质量、一致性等问题,反过来驱动治理策略的优化与完善。

###

在实践层面,企业应避免将三者割裂看待。一个成熟的数据中台或数据平台,正是将这三大能力产品化、服务化的具体体现。它通过统一的治理框架保障数据资产,通过灵活的集成工具连接全域数据,通过强大的处理服务赋能前端业务,最终构建起一个敏捷、可信、高效的数据驱动型组织。始于治理,通于集成,成于服务——这是释放数据全部潜能的必由之路。

如若转载,请注明出处:http://www.dlmkhjc.com/product/63.html

更新时间:2026-04-14 19:18:05